1. CNN (합성곱 신경망, Convolutional Neural Network)

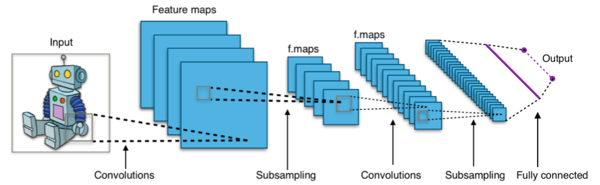

CNN은 이미지와 영상처럼 픽셀 데이터가 행렬 형태로 이루어진 데이터 처리에 특화된 신경망 모델.

이미지는 수많은 픽셀들로 이루어져 있으며, 공간적인 위치와 인접 픽셀 간 관계가 중요.

CNN은 이러한 특성을 반영해 지역적 특성을 추출하고 패턴을 인식한다

특징 (주요 기능)

- 합성곱 (Convolution): 이미지에 필터(커널)를 슬라이딩하면서 특징을 추출

- 풀링 (Pooling) : 이미지의 크기를 축소시키면서 불필요한 정보를 제거, 연산량 감소

- 주로 Max Pooling(최대값)과 Average Pooling(평균값)을 사용

- 활성화 함수 (ReLU) : 비선형성 부여 -> 복잡한 패턴 학습 가능

- 완전연결 (Dense) 층 : 최종적으로 이미지의 특징들을 연결해 분류 수행

CNN의 활용 예시

- 손글씨 숫자/문자 인식 (MNIST, EMNIST)

- 얼굴 인식 및 객체 탐지 (Face Recognition, YOLO)

- 의료 영상 분석 (질병 진단, 암 세포 검출)

- 자율주행 차량의 객체 탐지 (보행자, 차량 등)

주요 구성 요소

- Convolution Layer (합성곱 층) : 커널(필터) 윈도우를 입력 위로 슬라이딩하면서 국소 영역의 특징 맵(feature map) 생성

주요 파라미터 : 필터 개수, 필터 크기, 스트라이드, 패딩

- Activation Function (활성화 함수) : 비선형성 부여, 주로 ReLU

- Pooling Layer (풀링 층) : 차원 축소 및 위치 불변성 확보. MaxPooling, AveragePooling

- Flatten & Dense Layer (완전연결층) : 2D 특징 맵을 1D로 펼쳐 분류기 (fully connected)로 입력

꼭 알아야할 연관 개념

- 커널(Kernel, 필터): 이미지에서 패턴을 찾는 작은 행렬. 학습을 통해 최적화됨.

- 필터 수 증가는 층이 깊어질수록 데이터 표현력을 높임

- 과적합 주의 : 층이 깊어질수록 파라미터 급증 -> Dropout, 데이터 증강 필요

- Stride와 Padding:

- Stride : 커널이 한 번에 이동하는 픽셀 수

- Padding : 가장자리에 픽셀을 추가해 정보 손실 방지

- CNN 아키텍처 : LeNet(기본), AlexNet, VGG, ResNet(잔차 연결) 등 대표 모델들

2. RNN (순환 신경망, Recurrent Neural Network)

RNN은 순서가 존재하는 데이터(시퀀스 데이터)를 처리하는 신경망으로, 텍스트, 음성, 시계열 데이터 분석에 특화됨. 이전 단계의 출력이 다시 다음 단계의 입력으로 들어가는 구조.

특징 (주요 기능)

- 순환 구조로 인해 이전 정보를 기억하고 다음 단계로 전달할 수 있음 (hidden state)

- 시간의 흐름에 따라 입력 데이터를 순차적으로 처리 가능

활용 예시

- 자연어 처리 (감정분석, 챗봇 개발, 기계 번역)

- 주가 예측, 기상 예측 등 시계열 데이터 예측

- 음성 인식 및 합성

주요 구성 요소

1. Hidden State : 이전 시점 정보 압축 저장

2. Cell (셀) : 간단 RNN: h_t = activation(W·x_t + U·h_{t-1} + b)

3. 문제점 & 변형 : Vanishing/Exploding Gradient → LSTM(Long Short‑Term Memory), GRU(Gated Recurrent Unit)

연관 개념

- 장단기 기억 문제 : 기본 RNN은 긴 시퀀스를 처리할 때, 먼 과거 정보를 잘 기억하지 못하는 단점(소실/폭발 문제)이 있음

- 이를 극복하기 위한 변형 모델

LSTM(Long Short-Term Memory): 기억 셀을 통해 장기 기억 보존 가능.

GRU(Gated Recurrent Unit): 간단한 구조로 LSTM과 비슷한 효과.

- 어텐션 매커니즘 : 입력 데이터 중 중요한 부분에 집중하여 더 좋은 성능 달성 가능

- Sequence-to-Sequence: 번역, 챗봇 등에 인코더·디코더 구조 적용

- Gradient Clipping : 기울기 폭주 방지

- Teacher Forcing : 학습 시 예측 지연 최소화

- Masking : 가변 길이 시퀀스 처리

3. GNN (그래프 신경망, Graph Neural Network)

GNN은 데이터가 노드(Node)와 엣지(Edge)로 구성된 그래프 구조일 때 사용하는 딥러닝 기법

기존 행렬이나 이미지처럼 격자 구조가 아닌 자유로운 연결성을 가진 데이터를 다룬다.

특징 (주요 기능)

- 노드의 특성뿐만 아니라 인접 노드와의 관계(엣지 정보)를 함께 고려하여 학습 수행.

- 이웃 노드의 정보를 반복적으로 집계(Aggregation)하여 특징 벡터를 업데이트.

활용 예시

- SNS 사용자 분석(친구 추천, 커뮤니티 탐지)

- 추천 시스템 (상품 추천, 논문 추천)

- 화학/생물학 분자 구조 분석 (신약 개발 등)

주요 구성 요소

- Message Passing : 각 노드가 이웃으로부터 메시지 받아 합성

- Aggregation Function : Sum, Mean, Max 등으로 이웃 정보 집계

- Update Function : 집계 결과 + 자기 정보 → 새 노드 표현

연관 개념

- GAT(Graph Attention Network): 그래프 데이터에서 중요한 연결성을 선택적으로 집중.

- GCN(Graph Convolutional Network): 합성곱을 그래프 구조로 확장한 형태.

4. FNN ( 순전파 신경망, Feedforward Neural Network)

FNN은 데이터가 입력층에서 출력층까지 한 방향으로만 흐르는 가장 기본적인 신경망 구조 ( 입력→은닉층→출력으로 순방향)

모든 노드가 다음 층의 모든 노드와 연결된 완전 연결 구조(Dense Layer)를 가진다.

주요 기능

- 간단하고 직관적인 구조로 분류, 회귀 등 기본적이고 범용적인 문제에 적합 ( (feed‑forward)만 존재하는 기본 인공신경망. 회귀·분류 범용 모델)

- RNN과 달리 순차적 데이터 처리는 불가능

활용 예시

- 기본적인 분류 및 회귀 분석 (스팸 필터링, 고객 이탈 예측, 주택 가격 예측)

- 구조화된 데이터 분석(엑셀, csv 데이터)

- 보험, 의료, 금융과 같은 구조화된 데이터 분석

주요 구성 요소

- Input Layer: 특성(feature) 벡터 입력

- Hidden Layer(s): 완전연결(Dense) + Activation

- Output Layer: 회귀(activation 없음) 또는 분류(softmax/sigmoid)

연관 개념

- 활성화 함수(Activation Function): ReLU(비선형), Sigmoid(확률 값 출력), Softmax(분류 문제).

- 손실함수(Loss Function): 신경망의 출력과 정답 사이의 오차를 측정하는 함수.

- 역전파 알고리즘(Backpropagation): 오차를 이용하여 가중치를 업데이트하는 핵심 원리.

'Data Analysis Study' 카테고리의 다른 글

| CNN을 활용한 꽃 이미지 분류 (4) | 2025.07.22 |

|---|---|

| CNN을 활용한 CIFAR-10 이미지 분류 분석 (1) | 2025.07.21 |

| 데이터 분석 심화 학습: Boosting 기법 (AdaBoost, Gradient Boosting, 의사결정 나무) (5) | 2025.07.21 |

| 앙상블_소프트 보팅(VotingClassifier)을 통한 예측 수행 (1) | 2025.07.21 |

| 앙상블(Ensemble) 기법 개념 및 종류 정리 (0) | 2025.07.20 |